Langfuse 与 Open WebUI 的集成

Langfuse (GitHub) ��为 Open WebUI 提供开源的可观测性和评估功能。启用 Langfuse 集成后,您可以通过 Langfuse 跟踪您的应用程序数据,以开发、监控和改进 Open WebUI 的使用,包括:

如何将 Langfuse 集成到 Open WebUI

Langfuse 集成步骤

Langfuse 集成步骤

Pipelines 是 Open WebUI 中一个与界面无关的框架,用于 OpenAI API 插件。它支持注入拦截、处理和转发用户提示到最终 LLM 的插件,从而增强提示处理的控制和定制化。

要使用 Langfuse 跟踪您的应用程序数据,可以使用 Langfuse 管道,实现消息交互的实时监控和分析。

快速入门指南

第一步:设置 Open WebUI

确保 Open WebUI 正在运行。有关设置的详细信息,请参阅 Open WebUI 文档。

第二步:设置 Pipelines

通过 Docker 启动 Pipelines。使用以下命令启动 Pipelines:

docker run -p 9099:9099 --add-host=host.docker.internal:host-gateway -v pipelines:/app/pipelines --name pipelines --restart always ghcr.io/open-webui/pipelines:main

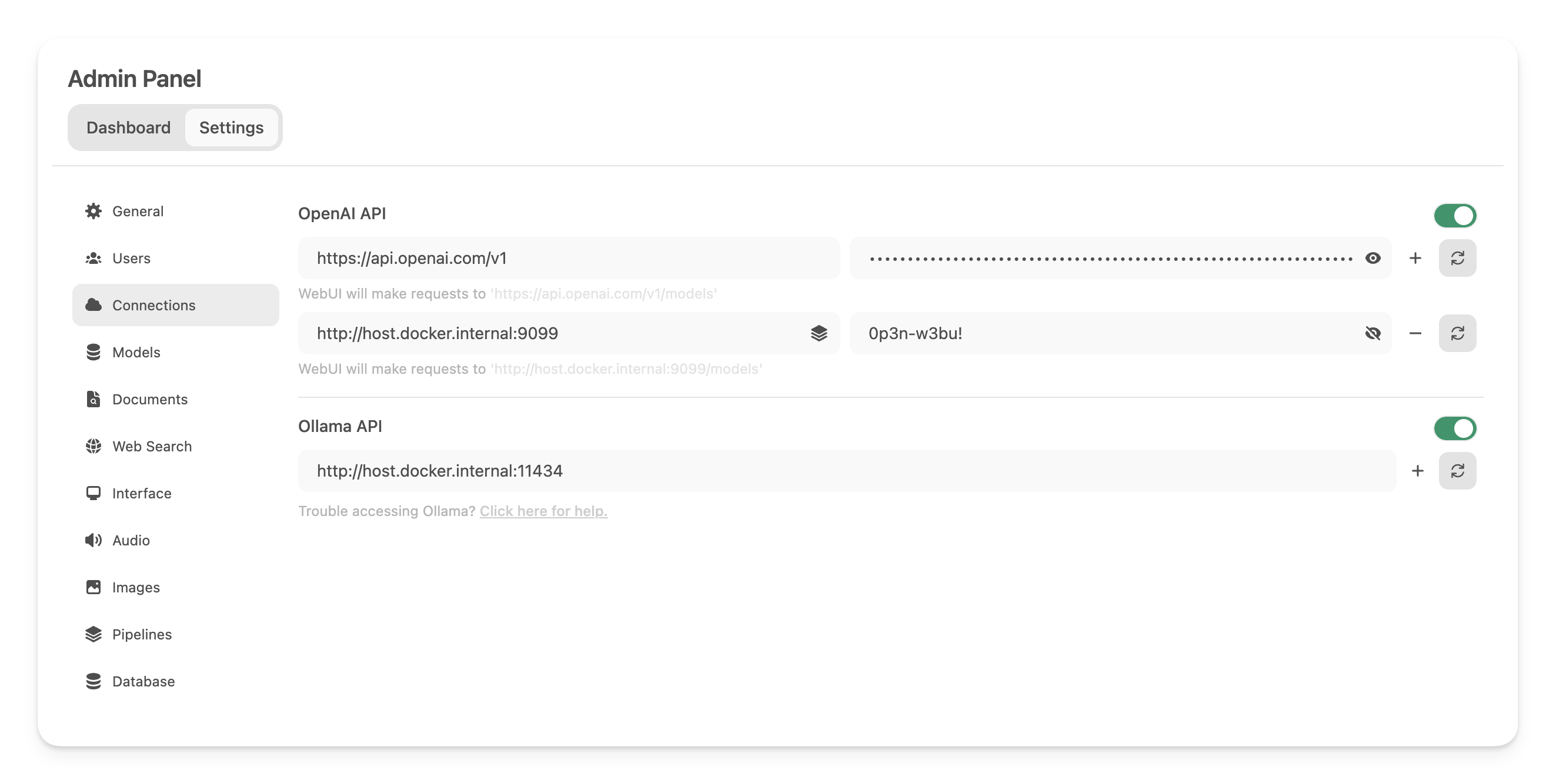

第三步:将 Open WebUI 连接到 Pipelines

在 管理员设置 中,创建并保存一个类型为 OpenAI API 的新连接,具体信息如下:

- URL:

http://host.docker.internal:9099(这是之前启动的 Docker 容器运行的地方)。 - 密码: 0p3n-w3bu!(标准密码)。

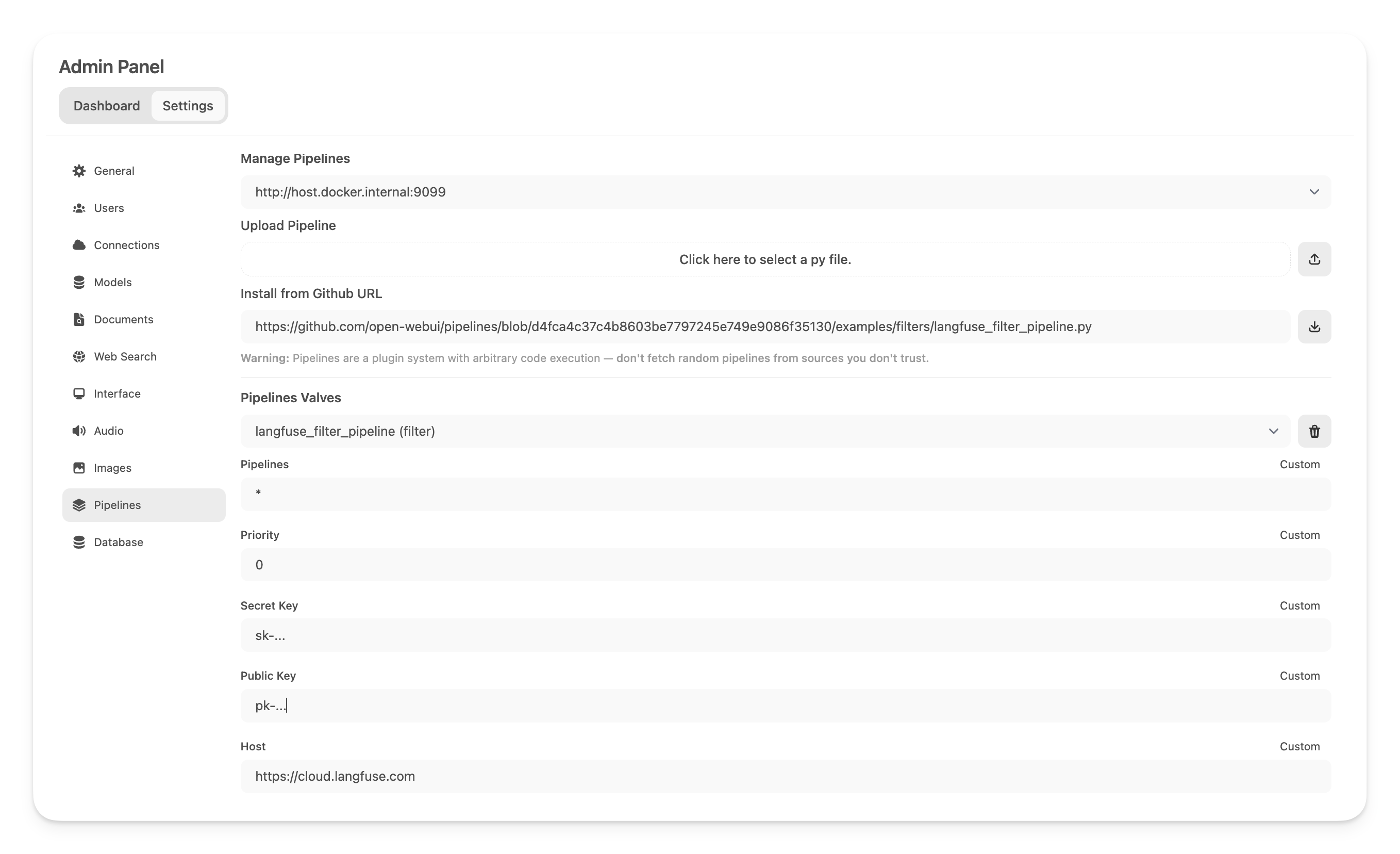

第四步:添加 Langfuse 过滤器管道

接下来,导航到 管理员设置 -> Pipelines 并添加 Langfuse 过滤器管道。指定 Pipelines 监听的地址为 http://host.docker.internal:9099(如前面配置),并通过 从 GitHub URL 安装 选项使用以下 URL 安装 Langfuse 过滤器管道:

https://github.com/open-webui/pipelines/blob/main/examples/filters/langfuse_filter_pipeline.py

现在,在下面添加您的 Langfuse API 密钥。如果您尚未注册 Langfuse,可以通过 此处 创建一个帐户获取您的 API 密钥。

注意: 如果启用了流式传输并想捕获 OpenAI 模型的使用情况(令牌计数),您需要导航到 Open WebUI 中的模型设置,并在 功能 下选中“Usage”选框。

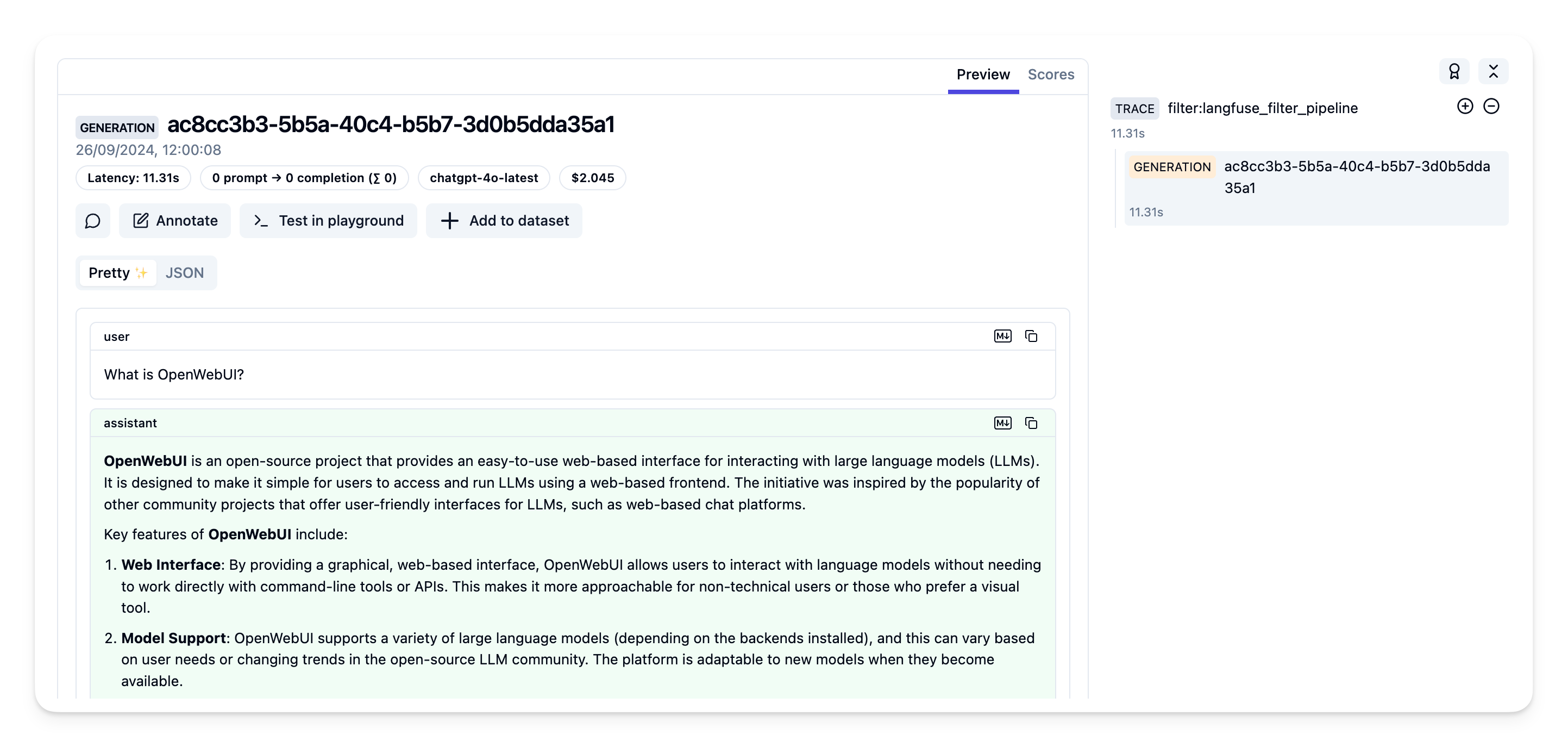

第五步:在 Langfuse 中查看您的追踪记录

现在您可以与 Open WebUI 应用程序交互,并在 Langfuse 中查看相关的追踪记录。

示例追踪记录 在 Langfuse 界面中显示如下:

了解更多

有关 Open WebUI Pipelines 的完整指南,请访问 这篇文章。